作者:中联科创特约嘉宾尹智

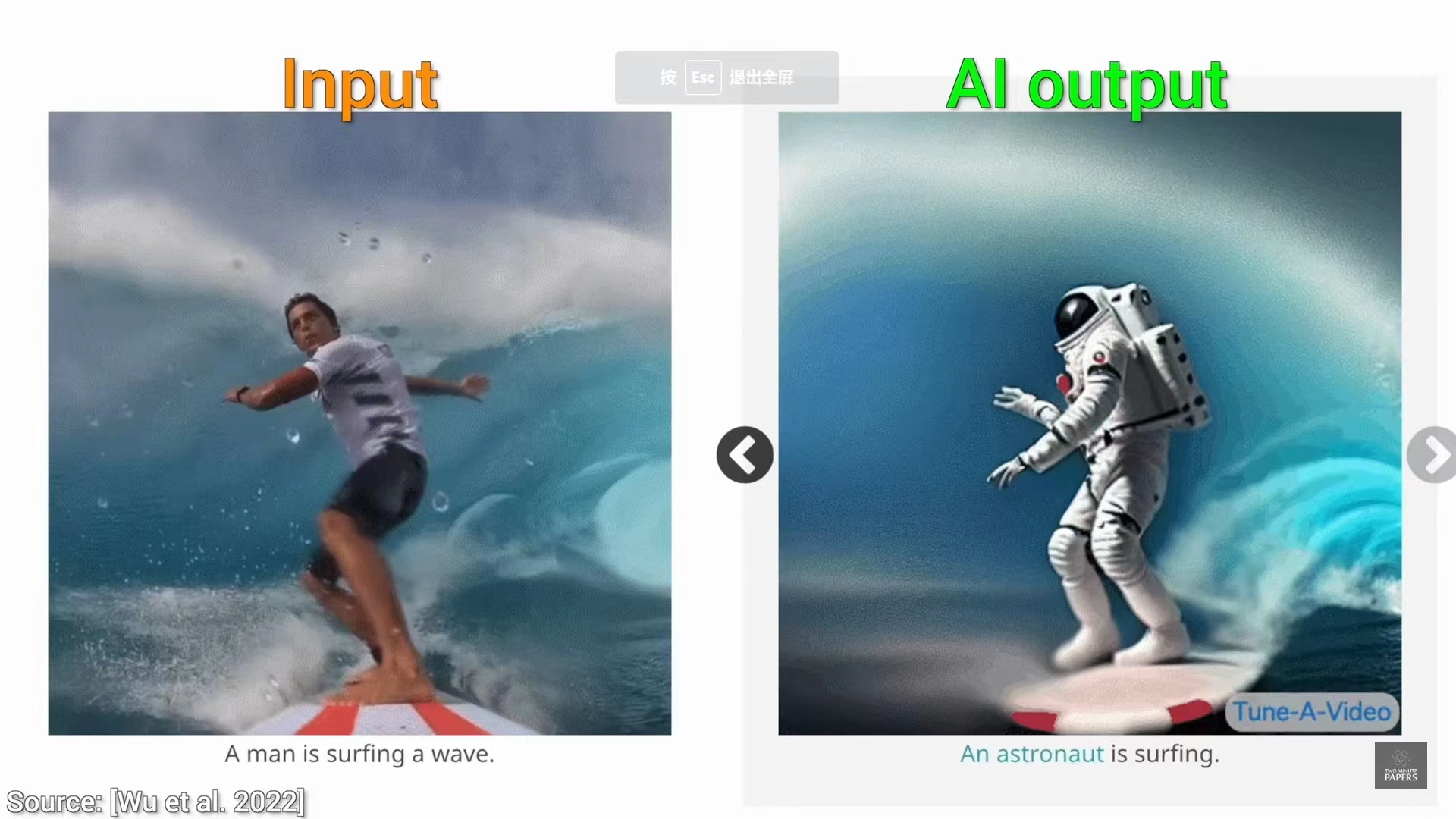

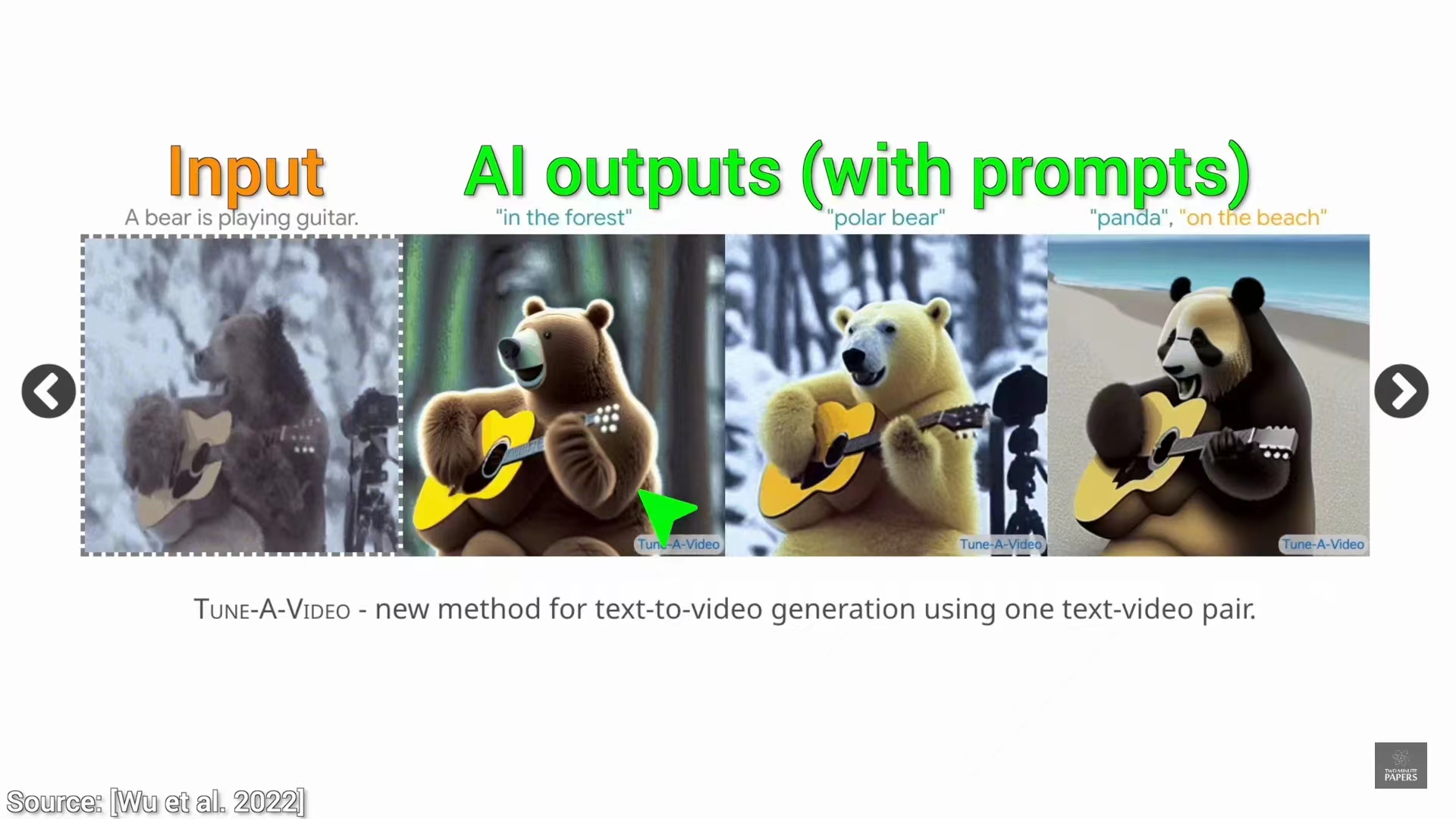

Text to Video (从文本生成视频)AI模型,会对广告业产生重大变革 —— 大家可能都知道Text to Image的AI模型比如 Dall -E2,可以直接用一句/段文本生成图片,而近期谷歌的一个算法,已经初步可以直接通过文字把一个视频的部分改换成文字指定的内容,比如输入的视频是一个 熊在雪地里弹琴,如果我们希望是把里头的熊换成熊猫,背景换成海滩,只要敲上一个提示词"熊猫","在海滩上",AI就直接能"偷梁换柱",如附图一二三;还有一家被称为实时视频内容生成工具的runway,也是输入文字,指哪改哪,如附图四五。这些技术最容易想到商业化的路径,自然是影视内容后期制作,无疑这将大大提高后期的效率,这个下次再说,今天要聊的是对视频广告的意义。

视频网站的广告模式主流形态还是开始前和中间播独占的视频广告,这给观众的体验其实很不好,而且很多时候突然插入的广告给观众留不下什么印象。视觉人工智能兴起之时,就有人开始琢磨了,如果不把广告专门占用几分钟,而是把广告"嵌入"到视频中呢?这不是指拍摄时的"软植入",而是通过AI的图像处理,在视频里适合的场景适合的部位智能"P"入广告内容,不仅不影响观看,而且潜移默化会在观众记忆中留下广告希望传递的印象 。

随着AIGC, Text to Video这类算法技术的成熟,在视频故事场景里或者某个物体上,放个商品,换个LOGO,甚至嵌入个特效,如附图六七那种效果,会变得越来越稀松平常。这意味着,媒体无需为广告单独找播放时间和广告点位,内容画面本身就是广告位 ,能吸引人们注意的地方,都有可能成为广告的载体;专业内容提供者,比如影视剧公司,也不用开拍前就拉好所有广告赞助,而且不但一直可以对内容中嵌入广告的收益分成,如果自己的剧集火了,还可以对场景中能出现什么产品和logo做动态定价/竞价 ;对观众来说,也不用再忍受跳不过的专属广告时间了。—— 仅代表尹智个人观点 Ken's personal view only